Depuis l’automne 2022, les IA génératives grand public ont intégré notre univers informationnel. Leur apparition impose aux citoyens d’être plus vigilants et aux médias d’information d’adopter des règles éthiques quant à leur utilisation.

Comment repérer une image générée par IA ?

Très vite, les IA génératrices d’images ont été accusées de provoquer des désordres informationnels. Si, au début, des erreurs grossières permettaient à chacun de les repérer assez facilement, plus les technologies se développent, plus cela est difficile et suppose donc que l’on recherche la source des images.

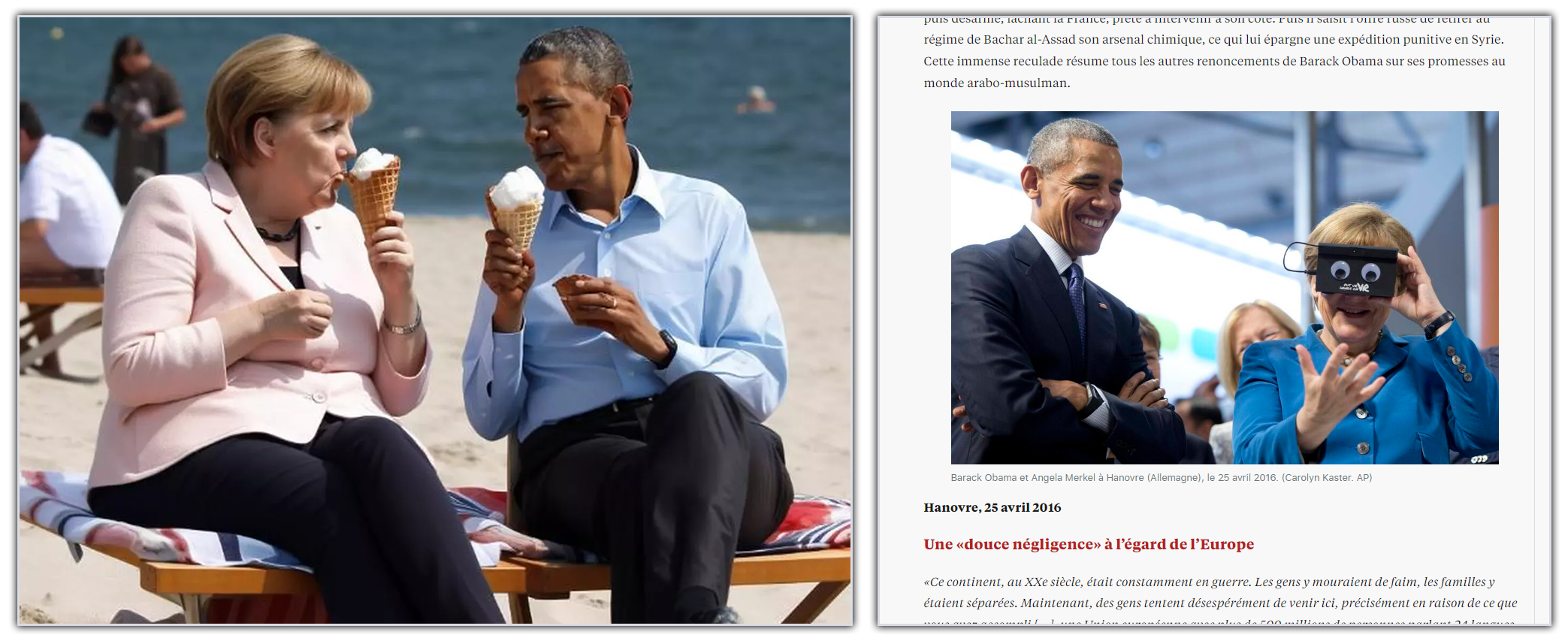

À gauche : Julian_ai_art/Midjourney. À droite : Barack Obama et Angela Merkel à Hanovre (Allemagne), le 25 avril 2016 (Carolyn Kaster. AP).

Ainsi, en regardant ces deux photos d’Angela Merkel et de Barack Obama sorties de leur contexte, il peut être difficile de faire la différence. C’est pourquoi, en plus d’analyser les détails de l’image, rechercher sa source et les éléments permettant de les contextualiser (légende et crédit photographique) s’avère essentiel. Pour la photo où les deux chefs d’État mangent une glace et qui a été générée par une IA, le crédit indique « © Julian_ai_art/Midjourney » et pour la seconde, prise par une photographe en 2016, on trouve « Carolyn Kaster/AP ».

Une piste pour travailler en classe avec les élèves est de leur apprendre à identifier la légende d’une image et les crédits photographiques : la légende décrit la photo ; les crédits photographiques sont des mentions légales qui donnent le nom du photographe et l’agence ou le média pour lequel il travaille. Identifier la source de l’image est donc la clé pour repérer si cette dernière a été générée ou non par l’IA.

Quel est le positionnement des médias français face aux IA génératrices d’images ?

Le Conseil de déontologie journalistique et de médiation (CDJM), organe professionnel d’autorégulation, a rendu un avis le 3 juillet 2023 au sujet de l’utilisation de l’IA. Le CDJM classe les utilisations des IA génératives en trois catégories :

- les utilisations à risque faible : correction orthographique et grammaticale, transcription d’enregistrements… ;

- les utilisations à risque modéré, qui doivent être signalées explicitement : compte-rendu technique d’une rencontre sportive, synthèse factuelle de résultats électoraux… ; « Lorsque des visuels générés par des outils d’IA (dessins, illustrations, vues d’artiste, reconstitutions…) sont utilisés, il ne doit être laissé aucun doute sur leur caractère artificiel et l’audience doit en être informée » ;

- les utilisations à proscrire (comme la diffusion de contenu généré intégralement par IA sans contrôle éditorial) : ces dernières « sont, de façon intrinsèque, incompatibles avec le respect de la déontologie journalistique ».

Les rédactions peuvent choisir ou non de suivre ces recommandations ou les adapter selon leur propre charte. Sur les 20 chartes d’utilisation de l’IA dans les médias publiées en 2023 et analysées par la Revue des médias, dans un article de janvier 2024, il se dégage de grands principes communs : ne pas publier de contenus générés par l’IA sauf si c’est le sujet traité et que l’exemple est illustratif, faire preuve de transparence et de traçabilité dans la production par l’IA.

Pauline Le Gall, formatrice CLEMI